A inteligência artificial criou um tsunami de expectativas nos últimos anos, com a popularização das plataformas de IA generativa, como o ChatGPT. No entanto, a maioria das empresas ainda está longe de tirar proveito de tudo o que essa tecnologia pode oferecer.

Isso acontece, em grande parte, não por limitações técnicas, mas por falta de estratégia e de maturidade organizacional. Afinal, a IA será tão poderosa quanto forem a intenção, a cultura e a qualidade dos dados que a sustentarem.

Durante a Conferência Gartner Data & Analytics, que aconteceu nos dias 28 e 29 de abril, em São Paulo, especialistas internacionais discutiram os desafios e oportunidades da IA. O diagnóstico foi que a IA promete muito, mas sua entrega ainda é tímida.

O que se vê, na prática, é uma corrida por resultados rápidos, sem o amadurecimento necessário das bases de dados, da governança e principalmente da cultura organizacional. Para os especialistas, as equipes se desgastam em ciclos intermináveis de preparação de dados e expectativas insanas.

Eles afirmam que esse ritmo implacável está afetando o moral ainda mais rápido do que os recursos. Por isso, as equipes precisam superar a crescente complexidade e as dúvidas sobre sua capacidade de entrega. A tentação de simplificar demais ou buscar soluções rápidas é um caminho perigoso, que deve ser evitado a todo custo.

Veja esse artigo em vídeo:

Segundo Maryam Hassanlou, diretora-analista do Gartner, apenas metade dos modelos de IA desenvolvidos nas empresas é adotada, uma taxa considerada muito baixa. “Confiança é a principal peça que falta”, explica, e isso acontece porque essas plataformas normalmente são “caixas-pretas” que dificultam seu entendimento e incentivam um uso irresponsável dos dados, que, para piorar, têm baixa qualidade e às vezes são insuficientes.

“Especialmente em setores regulamentados, como saúde, finanças e direito, potenciais vieses e padrões legais representam outra camada de complexidade para previsões que exigem a compreensão do processo”, acrescenta. “É por isso que a explicabilidade da IA é fundamental para ganhar a confiança.”

- Assine gratuitamente minha newsletter sobre IA, experiência do cliente, mídia e transformação digital

- Inscreva-se no meu podcast (escolha a plataforma): Spotify, Deezer, Apple Podcasts ou Soundcloud

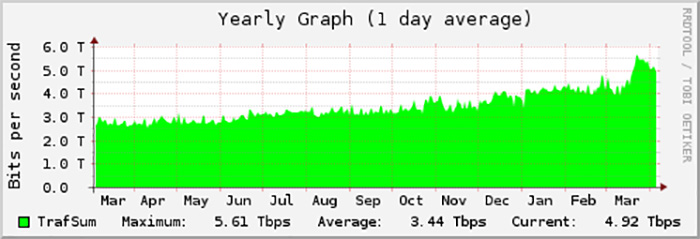

A explosão do uso da IA gerou um paradoxo. Ela oferece uma interface extremamente simplificada, mas isso vem aumentando exponencialmente a complexidade dos resultados, exigindo novas habilidades das lideranças de tecnologia e gestores de dados. Michael Simone, diretor-analista sênior do Gartner, afirma que agora os líderes “precisam ser pensadores estratégicos e muitas vezes também diplomatas”, conectando-se aos objetivos do negócio e educando os usuários.

“Cada fornecedor adicionou IA aos seus produtos, criando uma abundância de opções com promessas semelhantes”, alerta Jorg Heizenberg, vice-presidente-analista do Gartner. Para ele, esse “AI washing” representa um risco para a confiança na tecnologia, pois promete demais e entrega de menos.

Por tudo isso, a alfabetização em dados e em IA é um fator crítico de sucesso. “Essa conversa não tem nada de conto de fadas, pois cultura é uma questão prática, de colocar a mão na massa”, assegura Heizenberg.

É preciso envolver toda a organização nisso. “Você precisa estabelecer uma cultura de aprendizagem contínua para você e suas equipes”, acrescenta Debra Logan, vice-presidente-analista do Gartner. A transformação cultural é tão importante quanto a tecnológica.

Não há “dado neutro”

É preciso abandonar a ilusão do “dado neutro”. Deepak Seth, diretor-analista do Gartner, foi enfático ao afirmar que “a IA é enviesada porque os dados com os quais foi construída são enviesados, porque nossa história é enviesada”. Assim, eles carregam vieses que precisam ser identificados e mitigados. Ignorar isso não é apenas antiético, mas um enorme risco.

A ética deve, aliás, guiar todas as decisões envolvendo dados e IA, desde a coleta até a aplicação. Sua governança é uma extensão da governança de TI, introduzindo três elementos: diversidade, transparência e confiança. Isso inclui o combate a vieses, a proteção da privacidade e o compromisso com a inclusão e a diversidade. A IA deve ser vista como ferramenta de amplificação humana, não de substituição.

“Podemos fazer com que a IA seja como nós, inclusive com nossas limitações, mas podemos torná-la uma inteligência complementar ou tentar criar uma superinteligência”, explica Seth. Para ele, essa última, que empolga muita gente, é algo muito distante. “O que realmente deveria estar no centro das atenções é a criação de uma inteligência complementar, que não nos substitui, que não é mais inteligente do que nós, mas que nos complementa, nos ajuda a sermos melhores naquilo que fazemos”, conclui.

A revolução da inteligência artificial está em curso, mas seu sucesso depende menos de algoritmos e mais de pessoas. A explicabilidade dos modelos, a transparência nos processos e a responsabilidade na aplicação da tecnologia não são apenas requisitos regulatórios, mas imperativos de negócio.

O futuro da IA deve ser guiado por intencionalidade, inclusão e inovação com responsabilidade. Não basta implementar tecnologia avançada: é preciso fazê-lo com propósito claro, incluindo todas as vozes na conversa e inovando de forma ética e sustentável. Só assim transformaremos o tsunami de expectativas em um oceano de realizações concretas, onde a tecnologia amplia o potencial humano em vez de substituí-lo ou diminuí-lo.