Nesse ano, a inteligência artificial deixou de ser um interesse da elite tecnológica e conquistou o cidadão comum, virando tema até de conversas de bar. Muita gente agora a usa intensamente, criando tanto coisas incríveis, quanto enormes bobagens. Isso gerou uma excitação em torno da tecnologia, com grupos que propõem que seja desenvolvida sem nenhuma restrição ou controle, acelerando o máximo que se puder.

Isso pode parecer emocionante, mas esconde um tipo de deslumbramento quase religioso que de vez em quando brota no Vale do Silício, a meca das big techs, nos EUA. Um movimento especificamente vem fazendo bastante barulho com essa ideia. Batizado de “Aceleracionismo Efetivo” (ou “e/acc”, como se autodenominam), ele defende que a inteligência artificial e outras tecnologias emergentes possam avançar o mais rapidamente possível, sem restrições ou regulamentações.

Mas quem acelera demais em qualquer coisa pode acabar saindo da pista!

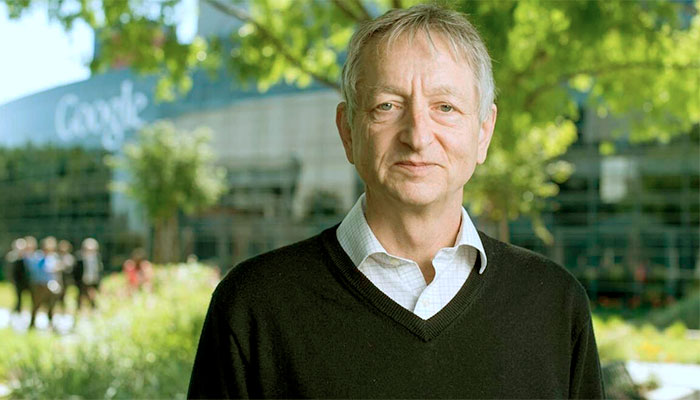

Eles desprezam pessoas que chamam de “decels” e “doomers”, aquelas preocupadas com riscos de segurança vindos de uma IA muito poderosa ou reguladores que querem desacelerar seu desenvolvimento. Entre eles, está Geoffrey Hinton, conhecido como o “padrinho da IA”, que no dia 1º de maio se demitiu do Google, para poder criticar livremente os caminhos que essa tecnologia está tomando e a disputa sem limites entre as big techs, o que poderia, segundo ele, criar “algo realmente perigoso”.

Como de costume, radicalismos de qualquer lado tendem a dar muito errado. A verdade costuma estar em algum ponto no meio de caminho, por isso todos precisam ser ouvidos. Então, no caso da IA, ela deve ser regulada ou seu desenvolvimento deve ser liberado de uma forma quase anárquica?

Veja esse artigo em vídeo:

O Aceleracionismo Efetivo surgiu nas redes sociais no ano passado, como uma resposta a outro movimento: o “Altruísmo Eficaz”, que se tornou uma força importante no mundo da IA. Esse último começou promovendo filantropia otimizada a partir de dados, mas nos últimos anos tem se preocupado com a segurança da sociedade, propondo a ideia de que uma IA poderosa demais poderia destruir a humanidade.

Já o aceleracionistas efetivos acham que o melhor é sair da frente e deixar a inteligência artificial crescer livre e descontroladamente, pois seus benefícios superariam muito seus eventuais riscos, por isso jamais deveria ser vista como uma ameaça. Para eles, as plataformas devem ser desenvolvidas com software open source, livre do controle das grandes empresas.

- Assine gratuitamente minha newsletter sobre experiência do cliente, mídia cultura e transformação digital

- Inscreva-se no meu podcast (escolha a plataforma): Spotify, Deezer, Apple Podcasts, Google Podcasts ou Soundcloud

Em um manifesto publicado no ano passado, os aceleracionistas efetivos descreveram seus objetivos como uma forma de “inaugurar a próxima evolução da consciência, criando formas de vida impensáveis da próxima geração”. De certa forma, eles até aceitam a ideia de que uma “super IA” poderia ameaçar a raça humana, mas a defendem assim mesmo, pois seria “o próximo passo da evolução”.

Para muita gente, como Hinton, isso já é demais! Em entrevista ao New York Times na época em que deixou o Google, o pioneiro da IA disse que se arrependia de ter contribuído para seu avanço. “Quando você vê algo que é tecnicamente atraente, você vai em frente e faz”, justificando seu papel nessas pesquisas. Agora ele teria percebido que essa visão era muito inconsequente.

Portanto é um debate em torno da ética do desenvolvimento tecnológico e das suas consequências. Conversei na época sobre aquela entrevista de Hinton com Lucia Santaella, professora-titular da PUC-SP. E para ela, “a ética da inteligência artificial tem que funcionar mais ou menos como a da biologia, tem que ter uma trava! Se não, os filmes de ficção científica vão acabar se realizando.”

A dificuldade de se regular

Além da questão ética, outro ponto que contrapõe aceleracionistas efetivos e altruístas eficazes é a necessidade de se regular a inteligência artificial. Mas verdade seja dita, essa tecnologia está dando um banho nos legisladores. Isso porque ela evolui muito mais rapidamente do que eles são capazes de propor leis.

Podemos pegar, como exemplo, a União Europeia, que legisla de forma rápida e eficiente temas ligados à tecnologia. Em abril de 2021, ela apresentou um projeto de 125 páginas como “referência” na regulação da IA. Fruto de três anos de debates com especialistas de diferentes setores associados ao tema, Margrethe Vestager, chefe da política digital do bloco, disse que o documento estava “preparado para o futuro”.

Parecia ser isso mesmo, até que, em novembro do ano passado, a OpenAI lançou o ChatGPT e criou uma corrida frenética para se incluir a inteligência artificial generativa em todo tipo de sistema. E isso nem era citado na proposta europeia!

O processo de criação de uma nova lei de qualidade é naturalmente lento, pois exige muita pesquisa e debate. Mas se as coisas acontecerem como propõem os e/accs, os legisladores estarão sempre muito atrás dos desenvolvedores. Os primeiros não conseguem sequer entender a tempo o que os segundos estão criando e, justiça seja feita, mesmo esses não têm total certeza do que fazem.

Enquanto isso, Microsoft, Google, Meta, OpenAI e outras gigantes da tecnologia correm soltas para criar sistemas que lhes concederão muito poder e dinheiro. A verdade é que quem dominar a IA dominará o mundo nos próximos anos.

Os aceleracionistas efetivos afirmam que eles são o antídoto contra o pessimismo dos que querem regular a inteligência artificial, algo que diminuiria o ritmo da inovação, o que, para eles, seria o equivalente a um pecado. Mas quanto disso é real e quanto é apenas uma “atitude de manada” inconsequente?

Sou favorável que a IA se desenvolva ainda mais. Porém, se nenhum limite for imposto, ainda que de responsabilização quando algo der errado, as big techs farão o mesmo que fizeram com as redes sociais. E vejam onde isso nos levou!

Não podemos perder o foco em nossa humanidade, que nos permite distinguir verdade de mentira, certo de errado! Só assim continuaremos desenvolvendo novas e incríveis tecnologias, sem ameaçar a sociedade.

Afinal, a ética consciente é o que nos diferencia dos animais, e agora, pelo jeito, também das máquinas!

Antes de encerrar, gostaria de fazer uma nota pessoal. Ainda que discorde filosoficamente dos aceleracionistas efetivos, acho o debate válido, se feito de forma construtiva. Pessoas com pontos de vista diferentes encontram juntas boas soluções que talvez não conseguiriam sozinhas, justamente por terem visões parciais de um tema. Para isso, necessitamos de conhecimento e de vontade de fazer o bem. Esse é um dos motivos para eu iniciar em 2024 meu doutorado na PUC-SP, sob orientação de Lucia Santaella, para pesquisar o impacto da inteligência artificial na “guerra” pelo que as pessoas entendem como “verdade”, algo determinante em suas vidas.