Quando foi lançado, o ChatGPT ganhou a alcunha de “assassino do Google”, pois muita gente achava que a sua proposta seria a nova maneira de se buscar conteúdo. Mas passados 33 meses, o uso do buscador mantém-se estável. A ironia é que uma novidade do próprio Google pode enterrar, aos poucos, seu formato consagrado.

Trata-se do “Modo IA”, que estreou no Brasil no dia 8, quatro meses depois dos EUA. Ele se parece ao ChatGPT, com uma janela para o usuário escrever o que quer e então receber uma resposta completa, construída pelo Gemini –a plataforma de IA do Google– sintetizando o conteúdo de páginas selecionadas pelo buscador.

Mas ao contrário do ChatGPT e do próprio Gemini, o “Modo IA” faz parte do buscador. Considerando que seu uso segue alto, isso pode ser determinante para popularizar o novo formato em substituição à busca tradicional. Assim a empresa pretende defender seu principal produto do crescimento das plataformas de IA concorrentes.

A novidade não deve ser vista como “apenas mais um recurso”. Seu sucesso pode alterar significativamente o processo de como buscamos conteúdo e construímos conhecimento, a exemplo do que o próprio Google fez no passado. Isso atende à demanda crescente por velocidade e praticidade, mas pode levar a ainda mais desinformação e conteúdos errados, e ampliar a tendência à superficialidade.

Mais grave é o risco de afetar cognitivamente os usuários. O “Modo IA” transforma a busca em um consumo passivo de respostas prontas, reduzindo o hábito de confrontar informações, exercitar a memória e analisar criticamente as fontes. Pela sua ilusão de completude, reduz a curiosidade e a busca por múltiplos pontos de vista, levando a um processo de “terceirização cognitiva”, em que delegamos tanta coisa às máquinas, que acabamos enfraquecendo nossa própria autonomia intelectual.

Surge então a dúvida legítima se esse recurso é mais positivo ou negativo para nós.

Veja esse artigo em vídeo:

Em julho de 2011, a pesquisadora Betsy Sparrow, da Universidade de Columbia (EUA), publicou, na prestigiosa revista científica Science, um artigo em que explicava como buscadores já funcionavam na época como “memórias externas” para nosso cérebro. Batizado de “Efeito Google”, ela demonstrou que memorizamos menos informações quando sabemos que elas podem ser facilmente encontradas. Em contrapartida, ficamos melhores em criar estratégias de pesquisa.

A inteligência artificial generativa nos leva a um outro patamar, pois a construção de respostas confrontando as fontes trazidas por um buscador é substituída por fazer boas perguntas ao sistema. Se as pessoas ainda analisassem criticamente as respostas da IA e verificassem sua correção, o problema não seria tão grande.

- Assine gratuitamente minha newsletter sobre IA, experiência do cliente, mídia e transformação digital

- Inscreva-se no meu podcast (escolha a plataforma): Spotify, Deezer, Apple Podcasts ou Soundcloud

Mas as respostas da IA transmitem a sensação de serem “verdades definitivas”, quando, na prática, são apenas construções probabilísticas feitas a partir de padrões de dados. Assim, ao terceirizar a seleção e interpretação, as pessoas podem perder o hábito de confrontar informações, criando uma relação passiva com o conhecimento, em que a resposta não vem da investigação, mas do consumo imediato.

Extrapolando as conclusões de Sparrow, a ciência mostra que, quando não precisamos acessar a memória ou estruturar argumentos, há um enfraquecimento de circuitos neurais ligados à retenção e à análise crítica. A IA então pode mesmo nos deixar mais rápidos, entretanto também mais superficiais, se abusarmos desse recurso. Funciona no curto prazo, mas enfraquece nossa autonomia intelectual no longo prazo.

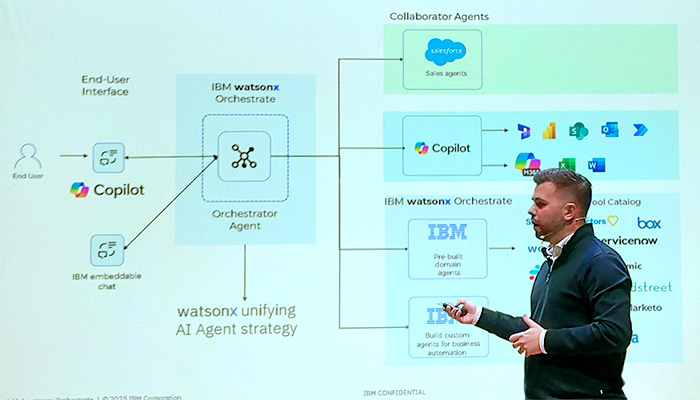

Outra pergunta legítima é por que o Google lançou o “Modo IA” se já tem a sua plataforma Gemini consolidada em smartphones e computadores. Entender a diferença entre ambos ajuda a esclarecer o escopo dessa novidade.

Google versus Google

O Gemini é o modelo de linguagem de IA da empresa, que alimenta diferentes aplicações, inclusive o próprio “Modo IA”. Este, por sua vez, oferece uma busca com raciocínio avançado, multimodalidade e capacidade de dividir perguntas complexas em subtópicos, com respostas aprofundadas em texto, tabelas e links relacionados.

O Gemini brilha em experiências amplas de assistente pessoal, realizando diversas tarefas, incluindo controle do smartphone, acesso a aplicativos, interação multimodal, personalização e respostas complexas em linguagem natural. Já o “Modo IA” é indicado para se obter respostas detalhadas e estruturadas a partir de múltiplas fontes da Web. Vale dizer que o Gemini também faz buscas, mas só se considerar que não consegue responder usando apenas seu treinamento.

Não se pode esquecer que todas essas plataformas –Gemini, “Modo IA”, ChatGPT e suas concorrentes– ainda erram muito. Um grupo de pesquisadores da OpenAI (criadora do ChatGPT) publicou recentemente um artigo em que reconhecem que isso acontece, em parte, porque elas são construídas para sempre darem uma resposta, mesmo que seja um “chute” baseado no que parece mais provável.

Isso se deve a como todos esses modelos são treinados, aprendendo a prever a próxima palavra em uma frase, mas sem informações sobre aquilo ser verdadeiro ou falso. As métricas tradicionais recompensam só respostas totalmente corretas e não penalizam erros, o que incentiva o modelo a arriscar e até inventar respostas, em vez de admitir quando não sabe ou está incerto. Para os pesquisadores, os modelos deveriam ser recompensados por indicar incerteza e punidos por erros cometidos com confiança excessiva, estimulando respostas mais cautelosas.

O Google avisa que “o Modo IA se baseia nos nossos principais sistemas de qualidade e classificação, e estamos usando abordagens inovadoras para aprimorar a veracidade”, e que “nem sempre vamos acertar, mas tenha certeza de que estamos trabalhando para melhorar dia após dia”.

Essa mea culpa é muito pouco para um recurso que pode impactar decisivamente como as pessoas construirão conhecimento de agora em diante.

A IA não é intrinsecamente boa ou ruim. Seu impacto depende de como é usada, regulada e compreendida. Ela oferece benefícios claros, como ampliar o acesso à informação, acelerar processos criativos e produtivos e até democratizar o conhecimento. Mas também carrega os riscos aqui debatidos, além da concentração de poder nas big techs e uma ameaça à sobrevivência dos produtores de conteúdo, tudo já debatido anteriormente nesse espaço.

Para um uso seguro e construtivo dessa tecnologia, as pessoas precisam adotar uma postura crítica, verificando informações, diversificando fontes e entendendo que respostas de IA não são verdades absolutas. Além disso, escolas, empresas e governos devem educar, regulamentar e incentivar boas práticas de uso. Por fim, as big techs devem buscar transparência, qualidade de dados, mecanismos de auditoria e abertura a revisões humanas, algo a que a maioria delas resiste ferozmente.

Só assim a IA deixará de ser uma ameaça à autonomia intelectual e se tornará um recurso poderoso para potencializar nossa capacidade de aprender, criar e decidir de forma consciente. Resta saber se conseguiremos fazer tudo isso.