No dia 16 de março, Any Awuada, pseudônimo de Nayara Macedo, ganhou grande destaque nas redes sociais por um vídeo em que disse que não engravidaria do jogador Neymar, com quem afirmou ter tido relações sexuais no Carnaval, por ter urinado logo após o sexo. Adultos se relacionam como e com quem quiserem. Mas afirmar, em um vídeo visto por milhões, de pessoas que a urina impede uma gravidez é uma irresponsabilidade inominável, pois muita gente acreditará nisso e passará a usar o próprio xixi como método anticoncepcional, o que evidentemente é falso.

Esse é só um exemplo recente da pilha interminável de mentiras que se acumulam nas redes sociais, mas que podem passar a ser encaradas como verdadeiras, pela visibilidade digital de seus autores. Alguns promovem os engodos por convicção, outros fazem por ignorância. Mas há também aqueles que pisoteiam a verdade porque têm interesses por trás daquilo, normalmente econômicos ou políticos.

O maior exemplo de embusteiro compulsivo beneficiado pelo meio digital é o atual presidente dos EUA, Donald Trump, amplamente conhecido por mentir despudoradamente para atingir seus objetivos. Apesar de, como líder da nação mais poderosa do mundo, estampar as manchetes de veículos de comunicação o tempo todo, ele continua usando o meio digital para espalhar suas desinformações mais absurdas, escapando do crivo dos jornalistas.

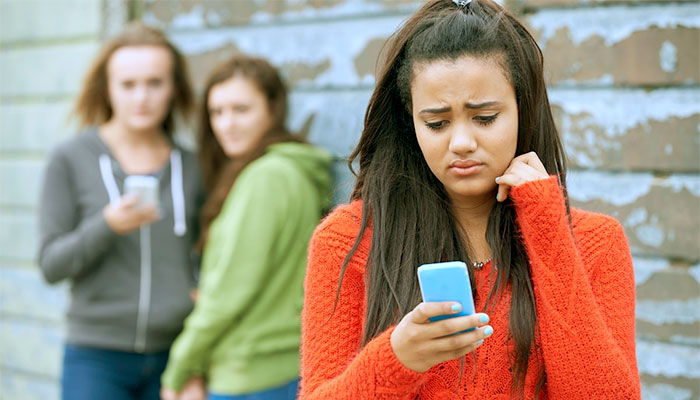

A enorme penetração das redes sociais, a falta de responsabilização dessas plataformas por ativamente promoverem mentiras, e os maus exemplos de governantes e celebridades continuam esgarçando o tecido social e criando novas gerações de propagadores de desinformação, que veem nisso uma forma de ascensão pela fama e pelo dinheiro. E as consequências sociais são gravíssimas.

Veja esse artigo em vídeo:

As redes sociais há muito se tornaram a principal fonte de consumo de informação boa e ruim no Brasil e no mundo. A pesquisa “Retrospectiva Digital 2024: Definindo o rumo para 2025”, publicado pela consultoria Comscore no dia 25 de março, indica que o Brasil tem 131 milhões de internautas, que gastaram 70 bilhões de horas no ano passado em redes sociais, contra apenas 1,1 bilhão em sites e aplicativos de notícias.

Trump sabe muito bem o poder disso, por isso explora a desinformação. Uma das mais perversas é a que relaciona vacinas a autismo. Essa mentira surgiu em 1998, quando o médico inglês Andrew Wakefield publicou um artigo na revista “The Lancet”, sugerindo essa relação com a vacina tríplice viral. O estudo foi formalmente retratado pela publicação em 2010, pois o autor havia manipulado dados para sustentar suas conclusões. Investigações revelaram que ele tinha conflitos de interesse, incluindo patentes de uma vacina concorrente e vínculos financeiros com advogados de famílias processando fabricantes de vacinas. Wakefield acabou perdendo sua licença médica.

- Assine gratuitamente minha newsletter sobre IA, experiência do cliente, mídia e transformação digital

- Inscreva-se no meu podcast (escolha a plataforma): Spotify, Deezer, Apple Podcasts ou Soundcloud

Embora a relação entre vacinas e autismo tenha sido refutada por estudos científicos sérios, o artigo foi devastador. Ele fortaleceu o movimento global contra vacinas, levando à queda na vacinação e ao ressurgimento de doenças evitáveis. Um exemplo emblemático é o do sarampo. A doença havia sido declarada eliminada nos EUA no ano 2000, mas ressurgiu com força graças a esses movimentos, especialmente nos Estados do Texas e do Novo México, onde eles são mais influentes.

Trump capitaliza o medo dos imunizantes para angariar votos de quem acredita nessa teoria desmentida. Tanto que, para reforçar sua retórica, ele nomeou, no seu segundo mandato, Robert Kennedy Jr., um conhecido ativista antivacinação, para liderar o Departamento de Saúde e Serviços Humanos dos EUA.

Pela sua posição, Trump tem o maior megafone do mundo, e isso influencia multidões pelo globo, que abraçam a desinformação. Isso acontece até com profissionais de uma determinada área, que atacam a própria ciência. Por exemplo, em outubro, aqui no Brasil, uma médica afirmou nas redes sociais que o câncer de mama não existe e um médico disse que a doença pode ser causada por mamografias. Ainda mais por serem médicos, essas declarações legitimaram crenças de uma legião de pessoas que, por qualquer motivo “não acreditam na doença”. Ambos respondem por investigações dos Conselhos de Medicina e processos.

“Me engana que eu gosto”

Em 2021, o instituto britânico Alan Turing publicou um estudo sobre como uma sociedade ameaça a própria sobrevivência com ataques deliberados à capacidade de adquirir conhecimento. A líder dos pesquisadores, Elizabeth Seger, da Universidade de Cambridge, explicou que, “mesmo que estivesse claro como salvar o mundo, um ecossistema de informações estragado e não-confiável poderia impedir que isso acontecesse”. Isso surge da desinformação (intencional ou não), do excesso de informação, da rejeição ao que contraria crenças do grupo e da dificuldade de julgar fontes nas redes. No fim, as pessoas confiam no que reforça sua visão de mundo.

Outro estudo, publicado em 2017 pelo Conselho da Europa e liderado por Claire Wardle, da Universidade de Harvard, detalha a “desordem informacional”. Ela se divide em desinformação (informação deliberadamente errada para causar danos), informação falsa (errada, mas sem intenção de causar danos) e informação maliciosa (correta, mas usada para causar danos). Também explica que é preciso considerar quem são os agentes (quem cria e distribui a mensagem, e qual sua motivação), as mensagens em si e os intérpretes (quem as recebe e suas interpretações).

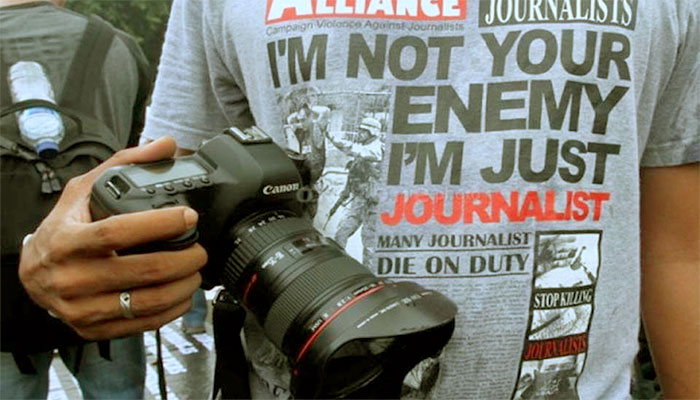

Isso afeta pessoas de todas as idades, grupos sociais e níveis educacionais. Os promotores da desinformação combatem a educação e a imprensa, que são contrárias aos seus interesses. Infelizmente são bem-sucedidos: o Digital News Report 2024, publicado em junho pelo Instituto Reuters e pela Universidade de Oxford, mostrou que 47% dos brasileiros deliberadamente se recusam a consumir notícias, e que apenas 43% confiam no noticiário, o pior índice já registrado no país.

Em seu livro “A Manipulação da Verdade” (Contexto, 2022), o destacado linguista francês Patrick Charaudeau afirma que “uma indiferença pela verdade, que se tornou ‘não essencial’, seria a marca registrada de nossa era pós-moderna”. E conclui que “o desafio não está mais em acreditar ou não acreditar, está no sucesso do fazer crer.”

Em um cenário em que as plataformas digitais fazem vista grossa e até, em alguns casos, incentivam a desinformação para aumentar seus lucros, em que legisladores se furtam a criar leis para combater esse mal, em que governantes a praticam diariamente, e em que influenciadores normalizam a prática irresponsavelmente, cabe a cada um de nós encontrar maneiras de nos informarmos melhor e de reforçarmos nosso senso crítico. Caso contrário, veremos mais e mais crianças nascendo porque seus pais acharam que a gravidez teria sido evitada com uma ida ao banheiro.