Todos nós usamos produtos do Google, da Meta, da Apple e de outras “big techs”. De fato, eles facilitam enormemente a nossa vida e ainda são rotulados como “grátis”.

Sabemos que não há nada de graça nisso. A explicação tradicional é que pagamos por eles com nossos dados, que permitem que essas empresas ganhem dinheiro, por exemplo, nos entregando anúncios hiperpersonalizados. É o chamado “capitalismo de vigilância”.

Mas a ascensão da inteligência artificial e a guerra aberta que as “big techs” travam contra qualquer forma de limitação de suas atividades, como estamos vendo no Brasil no embate contra o “PL das Fake News”, revela que esse controle que elas têm sobre nós é muito mais complexo, a ponto de que muita gente as defende nesses casos. E a tentativa de regulação da inteligência artificial fará nosso fracasso em impor limites razoáveis às redes sociais parecer algo pífio.

O que essas empresas realmente desejam é uma liberdade não-regulada para, entre outras coisas, substituir instituições da sociedade em áreas como saúde, educação, transporte ou segurança por soluções tecnológicas que, segundo elas, superariam a “ineficiência” do que temos hoje. Ao ocupar um espaço tradicionalmente sob cuidados do Estado, alcançariam um poder inimaginável, muito maior que o atual.

Eles só não dizem que tudo nessa vida tem um custo. Esse não será pago com publicidade em nossos celulares. Então “como essa conta fecha”?

Veja esse artigo em vídeo:

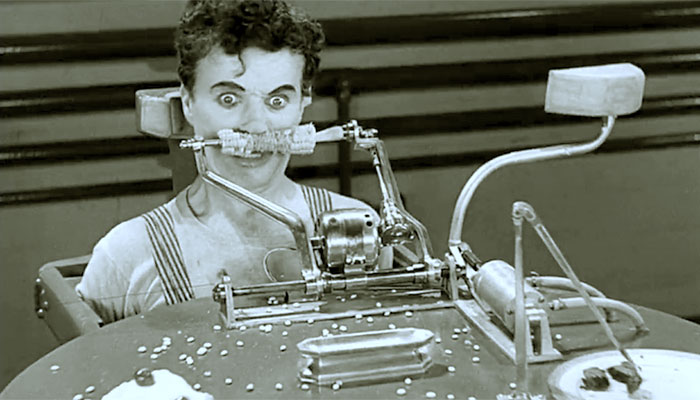

O avanço da inteligência artificial é inevitável e muito bem-vindo: ela tem o potencial de oferecer à sociedade benefícios até então inimagináveis. Mas isso significará que entregaremos muitas de nossas escolhas às máquinas, que decidirão o que elas acreditam ser o melhor para cada um de nós.

Em uma sociedade já encharcada de algoritmos, eles passam a controlar muito de nossa vida, de maneiras que nem percebemos. Nós não temos a menor ideia de quais são suas regras que decidem cada vez mais por nós. Diante de tanto poder, a falta de transparência das “big techs” e de explicabilidade de seus produtos se torna inaceitável e perigoso para nossas vidas e para a democracia. É justamente isso que essas empresas lutam para manter, pois, se soubermos detalhadamente o funcionamento de seus algoritmos, elas perdem o poder que têm sobre os cidadãos.

- Assine gratuitamente minha newsletter sobre experiência do cliente, mídia cultura e transformação digital

- Inscreva-se no meu podcast (escolha a plataforma): Spotify, Deezer, Apple Podcasts, Google Podcasts ou Soundcloud

Tudo isso vale para os algoritmos atuais, bem conhecidos e controlados pelas “big techs”. A inteligência artificial torna esse debate ainda mais importante, pois nem seus criadores entendem completamente as novas estratégias criadas pelas máquinas para solucionar problemas.

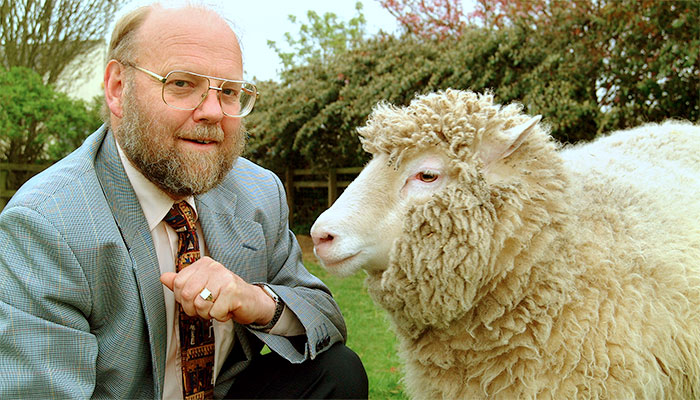

Se essas companhias lograrem criar a chamada “inteligência artificial geral”, aquela que não se limita mais a tarefas específicas e passa a se comportar de maneira semelhante à mente humana, tomando decisões sobre qualquer assunto, a situação pode ficar realmente dramática.

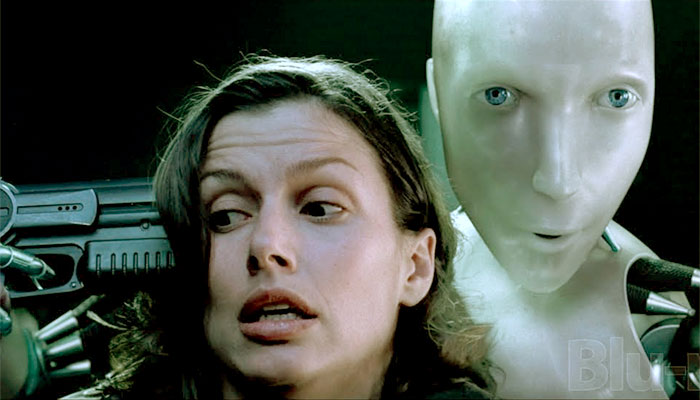

Imagine um sistema como esse que tenha assumido, com nosso consentimento, decisões críticas sobre a saúde pública. Em nome de deixar todo o sistema mais “eficiente”, ele pode passar a privilegiar cirurgias com mais chance de sucesso ou lucrativas, em detrimento das mais difíceis ou com menos ganhos. Mas todos merecem a chance de serem tratados, mesmo quem tem baixa possibilidade de sucesso. Essa é a visão humana de um médico, que uma máquina que acha que o fim justifica os meios pode ignorar.

Agora multiplique esses riscos acrescentando, na equação, segurança pública, educação e até economia de um país.

Nem sempre dá certo

O discurso do Vale do Silício enaltece o inegável poder transformador da tecnologia. É praticamente impossível viver hoje sem smartphones, buscadores ou redes sociais. Mas seus gurus adoram perpetuar as histórias de sucesso, enquanto ignoram os fracassos. E eles muitas vezes acontecem quando se tenta substituir uma instituição social por uma tecnologia.

Podemos pensar, como exemplo, no caso da Uber. Conceitualmente acho sua proposta muito interessante, mas ela parece “estar fazendo água”, particularmente no Brasil. Vocês devem se lembrar como a empresa chegou prometendo revolucionar a mobilidade urbana, como um substituto vantajoso ao transporte público, com suas corridas baratas e a possibilidade de se ganhar dinheiro dirigindo.

Foi um sucesso instantâneo: muita gente chegou a vender seu carro! Mas, para aquilo ser possível, a empresa queimava milhões de dólares em subsídios. Quando os investidores se cansaram de perder dinheiro e exigiram lucros, o modelo ruiu, com a consequente queda enorme na qualidade do serviço, que agora sentimos.

Porém o mais educativo desse exemplo é mostrar que nunca se propôs resolver o verdadeiro problema social, no caso as deficiências no transporte público. Substituía-se uma “gestão governamental ineficiente” por uma “solução tecnológica mágica”, cujo verdadeiro objetivo era sedimentar a dominância da empresa em seu setor. Quando a realidade bateu à porta, ficamos sem nada!

O grande desafio da nossa geração é tomar consciência de que somos cada vez mais dependentes da tecnologia e das empresas que as criam. Elas têm suas próprias agendas e narrativas de como estão melhorando e até “salvando” o mundo com seus produtos. Mas às vezes a sua necessidade de lucrar chega antes de salvarem qualquer coisa.

Não nos enganemos: como qualquer outra empresa, seu objetivo real é aumentar seus lucros, e, a princípio, não há nada de errado nisso. Mas esse objetivo não pode ser atingido às custas do desmantelamento das instituições da sociedade e dos mecanismos de proteção dos interesses da população.

Não estou propondo a interrupção do avanço tecnológico: ele é essencial para melhorarmos nossas vidas. Mas precisamos parar de acreditar candidamente que a tecnologia resolverá todos nossos problemas e melhorará magicamente a sociedade. Temos que ter consciência de como isso será feito e qual será o verdadeiro o custo social que pagaremos.

Tudo isso deve acontecer preservando os legítimos interesses das pessoas, o que muitas vezes conflitam com os dessas empresas. É por essas e outras que elas precisam ser reguladas. Elas não podem ser mais poderosas que os governos eleitos no mundo todo, nem mesmo substituir suas instituições.