Os brasileiros têm fama de abraçar novas tecnologias rapidamente, especialmente as digitais. Isso se vê, por exemplo, no amplo uso de smartphones e redes sociais no país, que sempre lidera rankings internacionais nisso. Também vem sendo observado no nosso uso entusiasmado da inteligência artificial. Mas essa euforia enfrenta severos obstáculos que podem prejudicar resultados, especialmente nos negócios.

A pesquisa “Inteligência artificial no mundo corporativo”, divulgada no dia 11 pela gigante de software alemã SAP, mostra que 52% dos gestores brasileiros têm percepção muito positiva sobre essa tecnologia e outros 27% a encaram de forma favorável, mas com ressalvas. Na América Latina, esses números são 43% e 38%.

Para 29% desses gestores, o maior desafio é não saber como incorporar a IA no negócio, enquanto 28% afirmam que não há profissionais qualificados para isso, problemas que caminham de mãos dadas. Mas o Brasil enfrenta outra grande barreira nesse setor: dependemos demais de tecnologias importadas.

A princípio, isso não pareceria tão grave. O Brasil historicamente consome tecnologia digital de fora, graças ao sucateamento de nossa indústria e de nossa ciência, principalmente a de base. Continuaremos fazendo isso com a inteligência artificial. Mas suas características tornam essa dependência mais perigosa.

O quadro piora com o posicionamento errático da administração Donald Trump, que já usa a IA como arma geopolítica. No dia 13, a OpenAI, criadora do ChatGPT, apresentou uma série de propostas ao governo americano para supostamente manter a liderança dos EUA no setor. Entre elas, sugere uma restrição de exportações da IA a países “democráticos” (conceito que varia com o vento nos cabelos de Trump).

Isso cria uma divisão geopolítica artificial, condicionando o acesso à IA à subordinação de nações a interesses americanos, reforçando essa dependência tecnológica e perpetuando desigualdades globais. Esse é um risco que o Brasil não pode manter.

Veja esse artigo em vídeo:

Sendo uma tecnologia altamente disruptiva, a IA já transforma diversos setores da economia. Para isso, requer infraestrutura avançada e capacitação de profissionais qualificados. Sem investimentos significativos, o Brasil pode ficar para trás em ambos, dificultando a absorção e o uso eficaz dessa tecnologia, o que pode também aumentar os riscos de segurança e privacidade, pois dados sensíveis ficam sujeitos a leis estrangeiras.

Isso também limita nossa capacidade de inovar e ajustar soluções às nossas necessidades, além de comprometer a autonomia tecnológica do país. Como a IA automatiza muitas funções, a falta de investimentos em capacitação impõe ao Brasil desafios adicionais no mundo do trabalho e na adaptação ao avanço tecnológico.

- Assine gratuitamente minha newsletter sobre IA, experiência do cliente, mídia e transformação digital

- Inscreva-se no meu podcast (escolha a plataforma): Spotify, Deezer, Apple Podcasts ou Soundcloud

Diante desse cenário, as empresas se mobilizam. Segundo a pesquisa da SAP, 62% dos gestores locais já capacitam seu pessoal para sanar este gargalo e outras 35% pretendem fazer isso ainda em 2025. “As empresas brasileiras trazem inovação no seu DNA, tanto na geração de diferencial competitivo, quanto na otimização de processos”, afirma Rogério Ceccato, diretor de pré-vendas da SAP Brasil. “Isso se explica com a maior maturidade do mercado brasileiro no cenário latino-americano.”

A IA generativa pode ajudar a reduzir esse problema, dispensando os profissionais de dominarem aspectos técnicos da tecnologia. Ceccato explica que assistentes, como a Joule da SAP, ajudam um profissional de vendas, por exemplo, a criar agentes de IA sem apoio técnico, concentrando-se no seu conhecimento do negócio. “Soluções com estratégia low-code/no-code (sem programação) permitem que mais profissionais dominem a IA”, acrescenta.

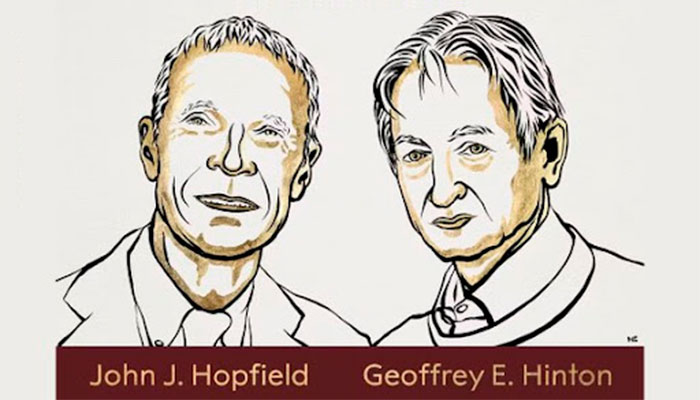

Além disso, alguns exemplos internacionais recentes animaram empresários e pesquisadores brasileiros a investirem mais em inteligência artificial. O mais marcante foi o chinês DeepSeek, que em janeiro demonstrou ser possível desenvolver um LLM (modelo de linguagem de grande porte) com qualidade comparável aos melhores do mundo, como o ChatGPT, por uma pequena fração dos seus investimentos.

Criou-se, assim, um novo paradigma, que retirou das big techs o “direito a dominar sozinhas” esse mercado.

Investimentos brasileiros

Na época, a ministra de Ciência, Tecnologia e Inovação, Luciana Santos (foto), disse que o Brasil desenvolverá seu próprio modelo de IA, citando o DeepSeek como exemplo. Ela lembrou que existia a ideia de que os investimentos para competir nessa tecnologia seriam proibitivos para países emergentes, mas os chineses mudaram isso, mesmo impedidos pelos EUA de comprar processadores mais poderosos.

Antes disso, no dia 30 de julho, o governo brasileiro anunciou o Plano Brasileiro de Inteligência Artificial. Ele detalha uma estratégia ambiciosa para os padrões brasileiros, com investimento de R$ 23 bilhões até 2028, para o desenvolvimento e aplicação ética e sustentável da IA no país.

O plano prevê a compra de um dos cinco supercomputadores mais avançados do mundo, que deve ser alimentado por energias renováveis. Também propõe o desenvolvimento de modelos de linguagem em português, treinados com conteúdo nacional, que contemplem nossas características culturais, sociais e linguísticas.

Sensível à falta de profissionais no setor, o projeto também destaca a capacitação em larga escala para atender a essa demanda. Por fim, reforça que o desenvolvimento da IA seja ético e responsável, promovendo a transparência algorítmica e a proteção de dados, itens críticos para o setor, mas pouco observados nos produtos americanos.

As propostas são interessantes e muito bem-vindas, mas a sociedade precisa acompanhar sua implantação, para que não se torne mais uma ideia populista que se perca na burocracia. A IA não pode ser mais uma revolução tecnológica que o Brasil apenas observe de longe.

Um esforço coordenado entre governo, academia e setor privado é imprescindível! Os programas já existentes precisam ser ampliados, especialmente para a formação de talentos e o desenvolvimento de propriedade intelectual nacional. Ainda podemos nos tornar protagonistas em nichos do ecossistema de IA.

As atuais restrições podem se traduzir em inovação acelerada. Mas, para isso, o Brasil precisará mobilizar recursos e talentos com a velocidade necessária para superar esse fosso tecnológico antes que se torne intransponível ou que eventuais restrições abalem decisivamente nossa transformação digital.